Senadores bolsonaristas brecaram a votação do projeto de lei de inteligência artificial nesta terça-feira (3) por oposição à cobrança de direitos autorais do conteúdo usado no treinamento de modelos de IA e ao conceito de “integridade da informação” incluído no texto.

O projeto 2.338/2023 seria votado na comissão temporária sobre inteligência artificial no Senado e, e seguida, no plenário da casa. Agora, a votação foi marcada para às 9h da quinta-feira (5). É a sexta vez que é adiada a votação do projeto que tramita desde maio de 2023 e recebeu 198 emendas.

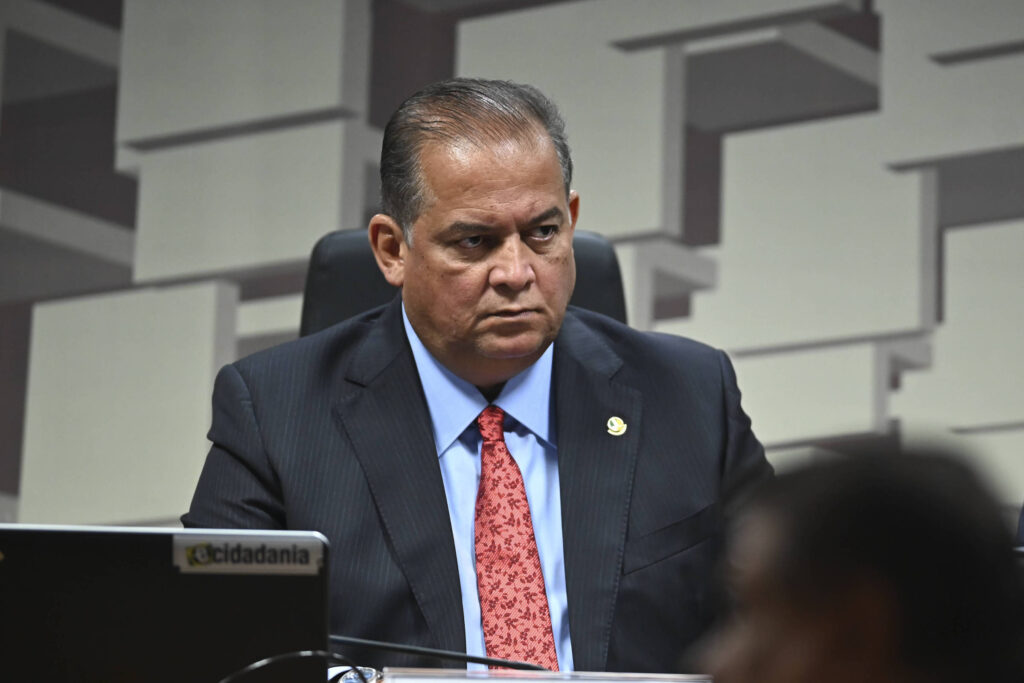

Liderada pelo senador bolsonarista Marcos Rogério (PL-RO), a oposição demanda a retirada do conceito de “integridade da informação” da legislação que regula os sistemas de IA no país de acordo com classificações de risco.

“Quem vai determinar o nível de confiabilidade, precisão e consistência das informações (para determinar se há integridade da informação)?”, disse Marcos Rogério à Folha. “O projeto está entregando para o Estado o papel de dizer qual informação é confiável. Isso cria um instrumento de censura, um ‘ministério da verdade’, não é compatível com liberdade de expressão.”

Nas redes sociais, contas ligadas à direita começaram uma campanha pressionando senadores a votar contra a aprovação do PL, afirmando que ele “enquadra as redes sociais como sistemas de alto risco que ficariam sob a apuração do presidente da República” e que o projeto equivale a censura. Em todas as outras tentativas de aprovar regulação de internet, como o PL 2630 (das Fake News) e o de streaming (PL 8.889/2017), contas bolsonaristas nas redes sociais se mobilizaram contra os projetos, acusando-os de censura.

O projeto em tramitação no Senado prevê que os sistemas de IA classificados como de “alto risco” estejam sujeitos a regras mais rígidas –precisariam passar por uma avaliação de risco, testar possibilidade de vieses e preconceitos e dar aos usuários o direito à revisão humana das decisões. Entre os sistemas de alto risco previstos no PL estão aqueles que atuam no controle do trânsito, seleção de estudantes para entrada em instituições de estudo e contratação e promoção de funcionários.

Sob pressão das plataformas, foi acatada uma emenda do senador Marcos Rogério que retirou do rol de alto risco os sistemas de curadoria, difusão, recomendação e distribuição automatizada de conteúdo. Trata-se dos algoritmos usados por empresas como YouTube, Google, X, TikTok e Meta para determinar como distribuir e recomendar conteúdo.

Apesar dessa vitória, as empresas e a oposição pressionam para a retirada do que veem como uma brecha para que as redes sociais voltem a ser enquadradas no rol de alto risco –a determinação de que sistemas que representem risco “à integridade da informação, à liberdade de expressão, ao processo democrático e ao pluralismo político” possam constituir novas hipóteses de IA de alto risco.

Eles acreditam que esses termos são excessivamente vagos e vão permitir ao órgão regulador censurar conteúdo, representando ameaça à liberdade de expressão.

“Já tiraram as redes sociais da classificação de alto risco, se retirarem menções a integridade de informação, haverá uma lei de IA que regula todos os setores, menos as plataformas de internet, que são o tipo de IA mais usados pelos brasileiros e que comprovadamente podem representar um risco à democracia”, diz Bia Barbosa, coordenadora de incidência dos Repórteres sem Fronteiras.

Mas interlocutores acreditam que a oposição ao conceito de “integridade da informação” seria, na realidade, um “bode na sala”. A maior objeção das empresas e da bancada bolsonarista seria a remuneração de direitos autorais sobre dados e conteúdo usados para treinar modelos de inteligência artificial, que poderia custar milhões às big techs.

As empresas afirmam que, do jeito que está no texto, a lei inviabiliza o desenvolvimento de sistemas de IA no país.

O relator do projeto, senador Eduardo Gomes (PL-TO), afirma que não abrirá mão do pagamento pelo uso dos dados.

“A obra é eterna, mas seu autor não é, a gente precisa pensar no dia a dia das pessoas que veem a sua produção ser utilizada rapidamente pelas redes sociais”, disse Gomes nesta terça (3).

As empresas defendem que todos os dados e conteúdos públicos na internet possam ser usados para treinar modelos de IA sem remuneração, a não ser que os autores ou detentores dos direitos façam o chamado “opt out”, ou seja, declarem que não querem que seu conteúdo seja usado.

No entanto, o governo defende que haja retroatividade —que autores que já tiveram seu conteúdo “raspado” sem autorização para treinar modelos de IA teriam direito a remuneração.

No entendimento das empresas, o uso do conteúdo para treinar modelos não deveria gerar pagamento de direitos porque não se trata de reprodução ou cópia. O paralelo usado é o de uma pessoa que lê uma obra de Machado de Assis e usa o conteúdo para inspirar um texto, sem reproduzir na integra.

O senador Marcos Rogério defende que o tema dos direitos autorais seja discutido em outro projeto de lei.

“A regulamentação precipitada e restritiva pode gerar impactos negativos para a sociedade brasileira”, disse. “Ao limitar a colaboração aberta e o uso de conteúdos, essas restrições poderiam estagnar o desenvolvimento de tecnologias nacionais. “